本周,欧洲人工智能治理取得了令人兴奋的进展,欧洲理事会部长委员会通过了《人工智能与人权公约》,而欧洲理事会最终批准了《欧盟人工智能法案》。乍一看,这有点令人困惑,不是吗?

首先,它们是不同的机构:欧洲理事会是欧洲人权组织,而欧洲理事会是欧盟的执行机构之一。其次,从逻辑上讲,这两份文件也是不同的。

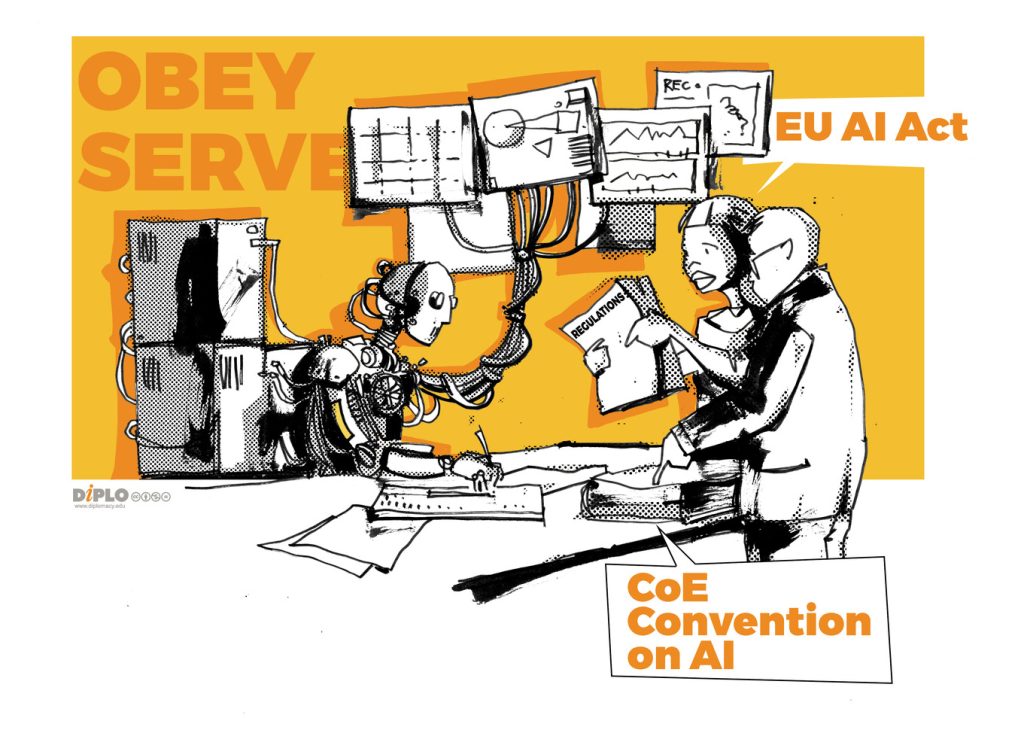

欧洲委员会通过了《人工智能与人权、民主和法治框架公约》。该公约涵盖了人工智能系统整个生命周期中可能影响人权、民主和法治的活动。该公约采用了类似于欧盟《人工智能法案》的基于风险的方法,这意味着对社会的潜在危害越大,监管就越严格。这种方法适用于人工智能系统的整个生命周期,从设计和开发到使用和退役。该公约具有国际性质,也向非欧洲国家开放。它将对签署国具有法律约束力。其范围是分层的:虽然签署国要将公约应用于“公共当局或代表其行事的私人行为者在人工智能系统生命周期内开展的活动”,但他们可以决定是否将其也应用于私人行为者的活动,或者针对此类行为者采取其他措施以满足公约的标准。关键条款包括针对特定情况和风险量身定制的透明度和监督要求。公约的规定不涉及国家安全活动。人们对该公约的有效性表示担忧,质疑它是否主要只是重申现有的做法,而不是引入实质性的监管措施。

欧洲理事会最终批准了《欧盟人工智能法案》。我们已经详细撰写了 有关《欧盟人工智能法案》 的文章。该法案旨在促进欧盟单一市场内安全可靠的人工智能系统的开发和采用。它采用基于风险的方法,这意味着对社会的潜在危害越大,监管就越严格。该法案仅适用于欧盟管辖范围内的地区,军事、国防和研究目的除外。《欧盟人工智能法案》没有提供选择:将人工智能系统或通用人工智能模型投放到欧盟市场的人工智能提供商必须遵守规定,其输出在欧盟境内使用的人工智能系统的提供商和部署者也必须遵守规定。

结论是什么?公约的视角更广泛,无论是条款还是执行问题,都不如欧盟法案详细。虽然两者之间有一些重叠,但这两份不同的文件是互补的。

中美关系紧张加剧、各国对芯片行业的投资增加、以及人工智能相关项目的推出,都使这一问题更加严重。

下周,所有人的目光都将集中在信息社会世界峰会 (WSIS)+20 论坛高层活动和人工智能造福全球峰会上。我们将为您带来部分会议的报告,因此请务必将超链接页面添加到书签中。

发表评论